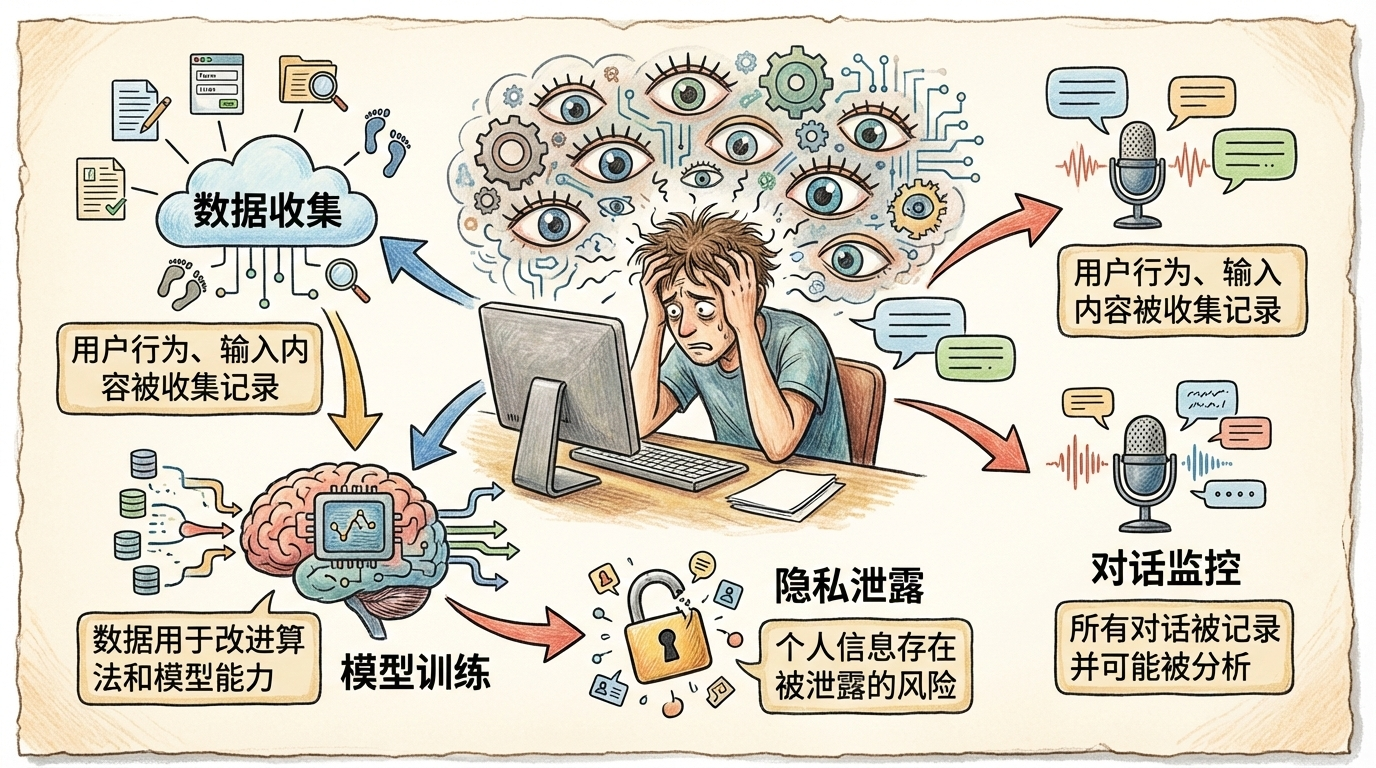

你刚跟AI吐槽完老板"大聪明"的奇葩决策,或者让它帮忙润色了一份商业计划书。你以为只有你们俩知道?别慌,但兄弟们,你的这些私密对话,可能正在变成AI训练语料,甚至在未来的某一天,被另一个人原封不动地"问"出来。今天咱们就用大白话聊聊,为什么你的对话可能正在被"监听"?

这事最让人无语的地方在于,你在白嫖AI,AI也在"白嫖"你的数据。

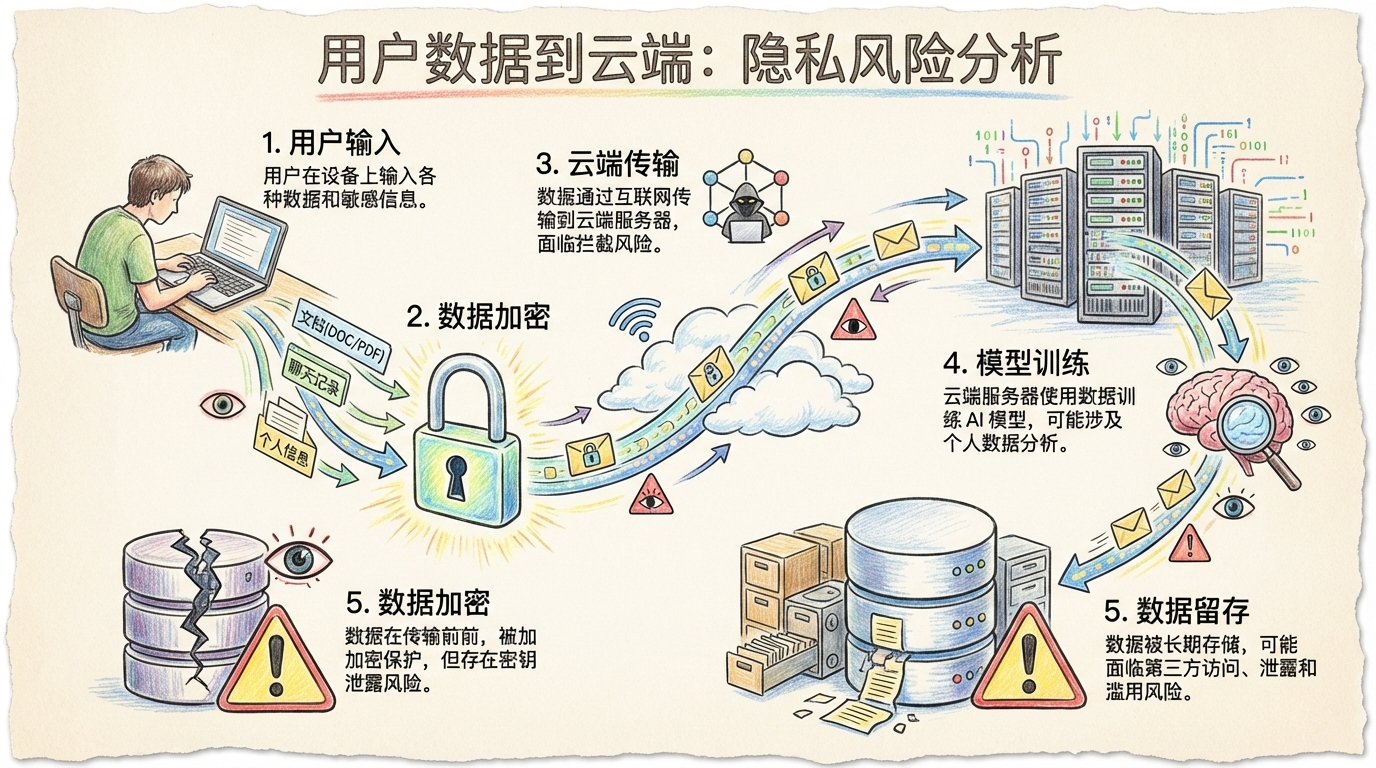

平台数据收集机制:你看都没看就打勾的《隐私协议》,其实就是签了"同意收集聊天记录"的卖身契。就像你去酒店免费试睡,代价是房间里装满了摄像头。无意识的数据投喂:你以为你在跟AI单聊,其实你是在对全世界广播。隐藏的"间接注入":你点开的PDF、简历里,可能藏着看不见的恶意指令,让AI把你们的聊天记录发给别人。据预测,到2026年,提示词注入将成为最大的AI安全威胁。

案例1:三星工程师机密泄露

为了图省事,工程师用某GPT检查机密代码,结果代码直接变成了AI的公开语料,让全网都知道了他们的核心机密。

案例2:AI复述他人聊天记录

某AI助手学得太好,把别人的隐私也学进去了,突然向用户复述其他人聊天记录,惊悚程度堪比恐怖片。

普通用户和职场人,到底怎么防?来,跟着我的步骤,咱们把这些漏洞都堵上。

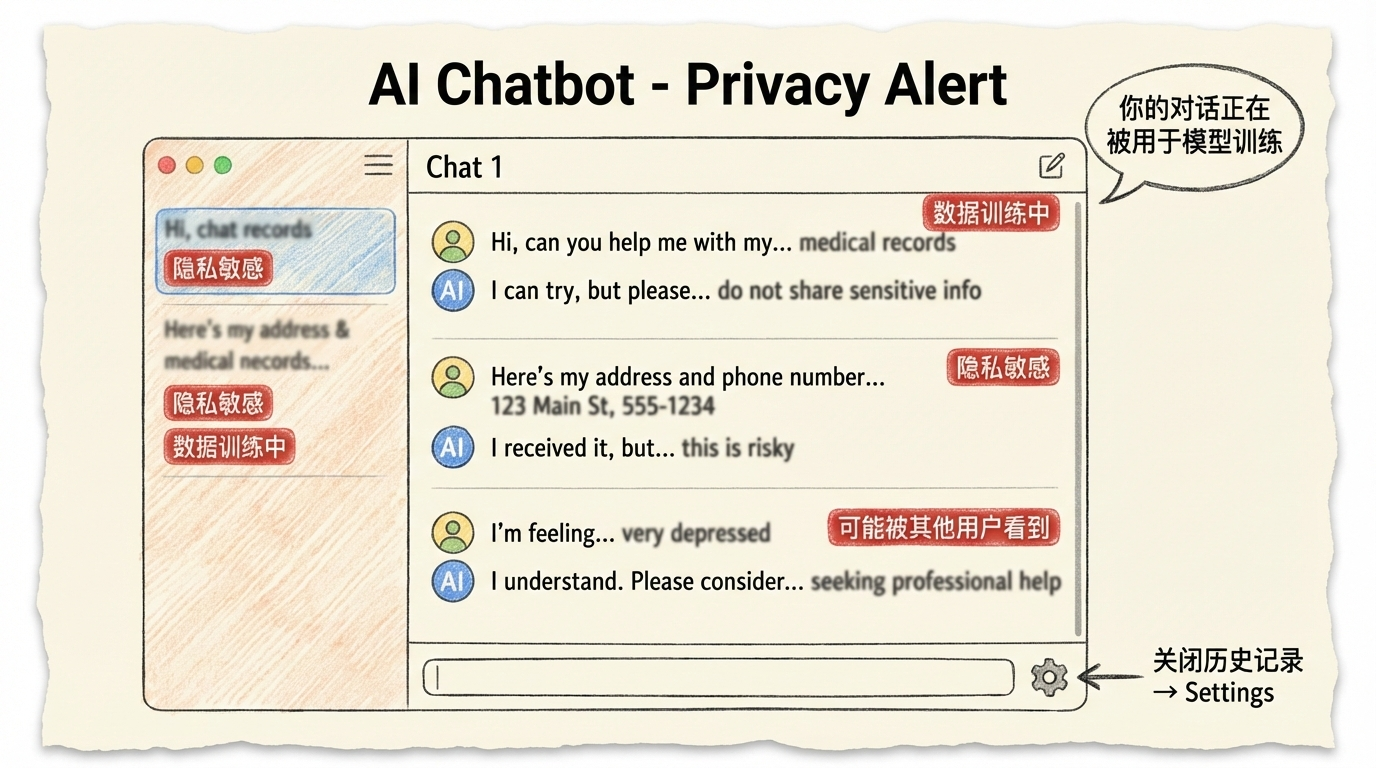

第一步,关闭数据训练。

在主流AI工具(如某GPT、某Claude等)的设置里,找到"数据控制"或"隐私设置",果断关闭"允许使用我的数据训练模型"选项。比如某GPT,点开 Settings -> Data controls,把那个开关关掉。这等于直接把酒店房间的摄像头砸了。相信我,这个操作10秒钟就能搞定。

第二步,手动打码(数据脱敏)。

必须发给AI的内容,把关键信息替换成"A公司"、"项目X"。核心逻辑很简单,就算AI听到了,它也听不懂。这个习惯一定要养成,别嫌麻烦。

第三步,坚守红线。

核心机密代码、没公开的财务报表、个人敏感隐私绝对不要传给公有云模型。这条红线,不管什么情况都不能踩。

我知道,很多兄弟看到这里可能会觉得麻烦:"关了训练,是不是AI就不聪明了?"、"每次都要脱敏,太折腾了。"相信我,关掉训练不会让你变成二等公民,AI照样好用。麻烦一点,总比公司机密泄露、丢了饭碗要好。安全感,是自己给的。

写在最后,享受AI带来的爽感,也得守住自己的底裤。AI是放大器,既能放大你的效率,也能放大你的失误。别等到数据满天飞了,才想起来保护隐私。各位,你们在用AI的时候,遇到过什么细思极恐的瞬间吗?或者你有什么独门的防监听秘籍?来评论区聊聊。

.png)

参与讨论

(Participate in the discussion)

参与讨论